Refleksje na temat SXSW: ramy odpowiedzialności i rozliczalności przemysłu w epoce generatywnej sztucznej inteligencji

Opublikowany: 2023-04-11W zeszłym miesiącu, tuż po ogłoszeniu naszego nowego generatywnego produktu AI, GrammarlyGO, wziąłem udział w konferencji SXSW w Austin w Teksasie. Energia wokół AI na SXSW była wyczuwalna, a apetyt na rozmowy wokół odpowiedzialnej AI inspirujący. Przekazałem tego ducha podczas czatu przy kominku na temat odpowiedzialności w The Grammarly AI Hub, a temat ten ugruntował moje przemówienie SXSW „Przyszłość sztucznej inteligencji: od sztucznej do rozszerzonej”.

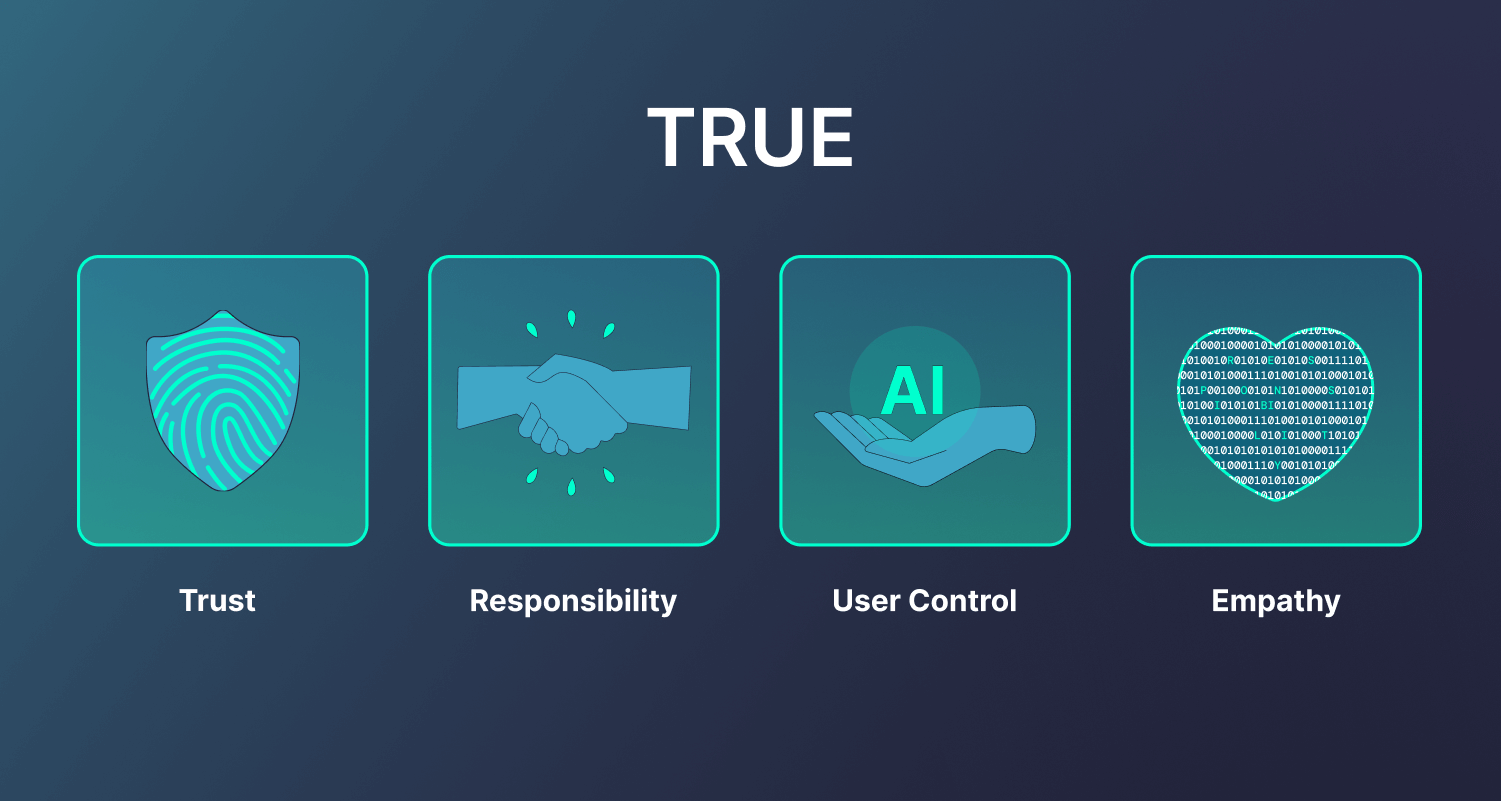

Gdy zaczynamy wdrażać GrammarlyGO dla naszych użytkowników i klientów, głównym celem pozostaje odpowiedzialne wdrażanie sztucznej inteligencji. Wcześniej pisałem o podejściu Grammarly do rozszerzonej inteligencji — idei, że sztuczna inteligencja odnosi sukces tylko wtedy, gdy jest stosowana w sposób, który zwiększa i umożliwia ludziom wykorzystanie ich potencjału. Rozszerzona inteligencja leży u podstaw naszej filozofii rozwoju produktu i stanowi podstawę TRUE, którą udostępniłem na SXSW, aby zademonstrować, w jaki sposób zespół produktowy Grammarly podchodzi do wszystkich wykorzystywanych przez nas technologii — w tym do generatywnej sztucznej inteligencji.

Odpowiedzialne ramy sztucznej inteligencji, takie jak TRUE, mogą kierować rozwojem produktów, które wspierają ludzi w różnych branżach, technologiach i przypadkach użycia. Kiedy te ramy są wdrażane na dużą skalę, możemy stworzyć przyszłość, w której osoby fizyczne i firmy będą w pełni realizować swój potencjał, budować głębsze połączenia i osiągać wyniki. Wierzę, że PRAWDZIWE ramy, które opierają się na czterech podstawowych zasadach — zaufaniu, odpowiedzialności, kontroli użytkownika i empatii — mogą skierować nas w kierunku tej przyszłości.

Oto spojrzenie na to, w jaki sposób stosujemy strukturę TRUE, aby upewnić się, że nasze wdrożenie generatywnej sztucznej inteligencji spełnia naszą obietnicę zwiększania naszych klientów, przy jednoczesnym priorytetowym traktowaniu ich autonomii, prywatności i bezpieczeństwa.

Zaufanie: stawianie standardów i praktyk w zakresie bezpieczeństwa i prywatnościna pierwszym miejscu

Trwałe zaangażowanie Grammarly w ochronę prywatności i bezpieczeństwa prowadzi do naszych PRAWDZIWYCH ram i jest podstawą naszego modelu biznesowego. Dostosowanie naszych zachęt do zachęt naszych klientów ma kluczowe znaczenie dla budowania zaufania. Zarabiamy na sprzedaży subskrypcji — nie sprzedajemy danych klientów stronom trzecim w celach reklamowych lub szkoleniowych. Ponadto usuwamy dane identyfikacyjne i anonimizujemy dane użytkowników, przechowując je tylko tak długo, jak jest to konieczne do świadczenia i ulepszania naszych usług.

Jeśli prywatność polega na tym, jak chronimy prawa użytkowników do kontrolowania i uzyskiwania dostępu do ich danych, bezpieczeństwo polega na tym, jak chronimy te dane. Jesteśmy głęboko zaangażowani w bezpieczeństwo — a dzięki 14-letnim inwestycjom uważamy bezpieczeństwo za najważniejszą cechę naszego produktu w sercu naszego ekosystemu produktów.

Działamy z obsesją na punkcie bezpieczeństwa, przestrzegając najlepszych w swojej klasie zasad i praktyk, takich jak jednokrotne logowanie dla wszystkich kont Grammarly Business, zewnętrzne testy penetracyjne i osadzenie naszych wewnętrznych ekspertów ds. bezpieczeństwa w naszych zespołach produktowych i inżynieryjnych . Te zabezpieczenia umożliwiają nam uzyskanie atestów i certyfikatów stron trzecich. Utrzymujemy te wysokie standardy, wdrażając generatywną sztuczną inteligencję w naszych produktach dzięki nowym innowacjom, takim jak GrammarlyGO.

Odpowiedzialność: budowanie i ulepszanie systemów sztucznej inteligencji, które zmniejszają uprzedzenia i promują uczciwość

Wyniki konkursu prognostycznego prowadzonego przez Jacoba Steinhardta, profesora z Uniwersytetu Kalifornijskiego w Berkeley, sugerują, że możliwości uczenia maszynowego rozwijają się szybciej niż ich zdolność do niezawodnego działania z nowymi i nieoczekiwanymi zestawami danych. Oznacza to, że technolodzy są odpowiedzialni za wdrażanie poręczy, które czynią sztuczną inteligencję bezpieczniejszą.

Nasz zespół ds. odpowiedzialnej sztucznej inteligencji robi to codziennie, budując wysokiej jakości zbiory danych i stosując taktyki, aby algorytmy w naszych produktach nie utrwalały uprzedzeń ani stereotypów. Używamy wewnętrznych technologii, aby uniemożliwić GrammarlyGO interakcję z drażliwymi tematami, zmniejszając ryzyko związane z bezpieczeństwem.

Częścią odpowiedzialnego rozwoju sztucznej inteligencji jest uznanie, że żaden system nie jest doskonały. Dlatego zapewniamy użytkownikom wiele mechanizmów zgłaszania problemów w naszych produktach i stosujemy rygorystyczny proces operacyjny, aby szybko i konsekwentnie rozwiązywać problemy i ulepszać nasze modele.

Kontrola użytkownika: pomaganie ludziom i firmom w osiągnięciu pełnego potencjału przy jednoczesnym poszanowaniu ich autonomii

Ponieważ wspomagana przez sztuczną inteligencję pomoc w komunikacji staje się coraz bardziej zaawansowana, nic nie zastąpi ludzkiego głosu. Komunikacja jest niezwykle osobista i jest dla nas bardzo ważne, aby nasi klienci zawsze zachowali kontrolę, a dostarczana przez nas technologia pomaga ludziom i firmom osiągnąć najwyższy potencjał.

Starannie zaprojektowaliśmy GrammarlyGO, aby zapewnić opcje i sugestie do rozważenia – zawsze ostatecznie zwracając się do klienta, aby zdecydował, co jest dla niego najlepsze. Nie było to przypadkowe — poszanowanie autonomii naszych użytkowników pomaga zapewnić, że nasza technologia spełnia swój cel, jakim jest ich udoskonalanie. Dzięki GrammarlyGO pomagamy ludziom oszczędzać czas na ich codziennym pisaniu, umożliwiając im poświęcenie większej ilości cennej energii na opracowywanie wielkich pomysłów, opracowywanie kreatywnych strategii i współpracę nad najbardziej wpływowymi zadaniami w ich organizacjach.

Empatia: Wchodzenie w buty naszych klientów, aby zrozumieć i odpowiedzieć na ich rzeczywiste potrzeby

Wierzymy, że kluczowym sposobem na zminimalizowanie niezamierzonych skutków nowych technologii jest skupienie się na konkretnych wyzwaniach, przed którymi stają ludzie. Nieustannie poszukujemy nowych technologii, aby pogłębić wartość, którą dostarczamy naszym klientom, i to była jedna z motywacji do zintegrowania generatywnej sztucznej inteligencji z naszymi produktami.

Na przykład GrammarlyGO może pomóc ludziom przezwyciężyć problem „pustej strony” — coś, w czym 84 procent użytkowników Grammarly powiedziało nam, że potrzebuje wsparcia. Ponadto usłyszeliśmy od naszych użytkowników, że zmagają się z ilością otrzymywanych wiadomości e-mail i są przytłoczeni zadaniem szybkiego i skutecznego reagowania. W odpowiedzi na ten problem stworzyliśmy funkcję w GrammarlyGO, która umożliwia ludziom szybkie odpowiadanie na wiadomości e-mail w dostosowany do kontekstu, spersonalizowany sposób.

Ponieważ wprowadzamy nowe przypadki użycia do oferty produktów Grammarly, ta intencja pozostanie na pierwszym planie.

Przyszłość sztucznej inteligencji jest rozszerzona

Chociaż podzieliłem się tylko jednym przykładem tego, jak Grammarly niedawno wykorzystało platformę TRUE, mam nadzieję, że każdy, kto opracowuje produkty z nowymi technologiami, powieli lub znajdzie inspirację w tym podejściu. Jestem przekonany, że przyszłość sztucznej inteligencji leży w rozszerzonej inteligencji — i zachęcają mnie rozmowy na SXSW i w całej branży na temat utrzymywania ludzi w centrum decyzji dotyczących produktów.

Chcę żyć w świecie, w którym wykorzystujemy sztuczną inteligencję, aby stać się lepszymi, umożliwiając jednostkom i zespołom wykorzystanie ich potencjału i wywarcie dużego wpływu na firmy, organizacje i branże. Gdy jako społeczeństwo dostosowujemy się i uczymy, ramy takie jak TRUE mogą pomóc nam urzeczywistnić tę przyszłość.

W mojej nowej roli przyszłego dyrektora generalnego Grammarly, nasza obietnica zwiększenia liczby naszych klientów jest dla mnie tak samo ważna jak zawsze - i nie mogę się doczekać, aby kontynuować budowanie na tym dziedzictwie, gdy Grammarly wkracza w nową erę z generatywną sztuczną inteligencją.