Uma estrutura para a responsabilidade e prestação de contas da indústria na era da IA generativa

Publicados: 2023-04-11No mês passado, logo após anunciar nossos novos recursos de produtos de IA generativa, participei da conferência SXSW em Austin, Texas. A energia em torno da IA no SXSW era palpável e o apetite por conversas sobre IA responsável era inspirador. Canalizei esse espírito durante um bate-papo sobre responsabilidade no The Grammarly AI Hub, e o tópico baseou minha palestra no SXSW, “O futuro da IA: do artificial ao aumentado”.

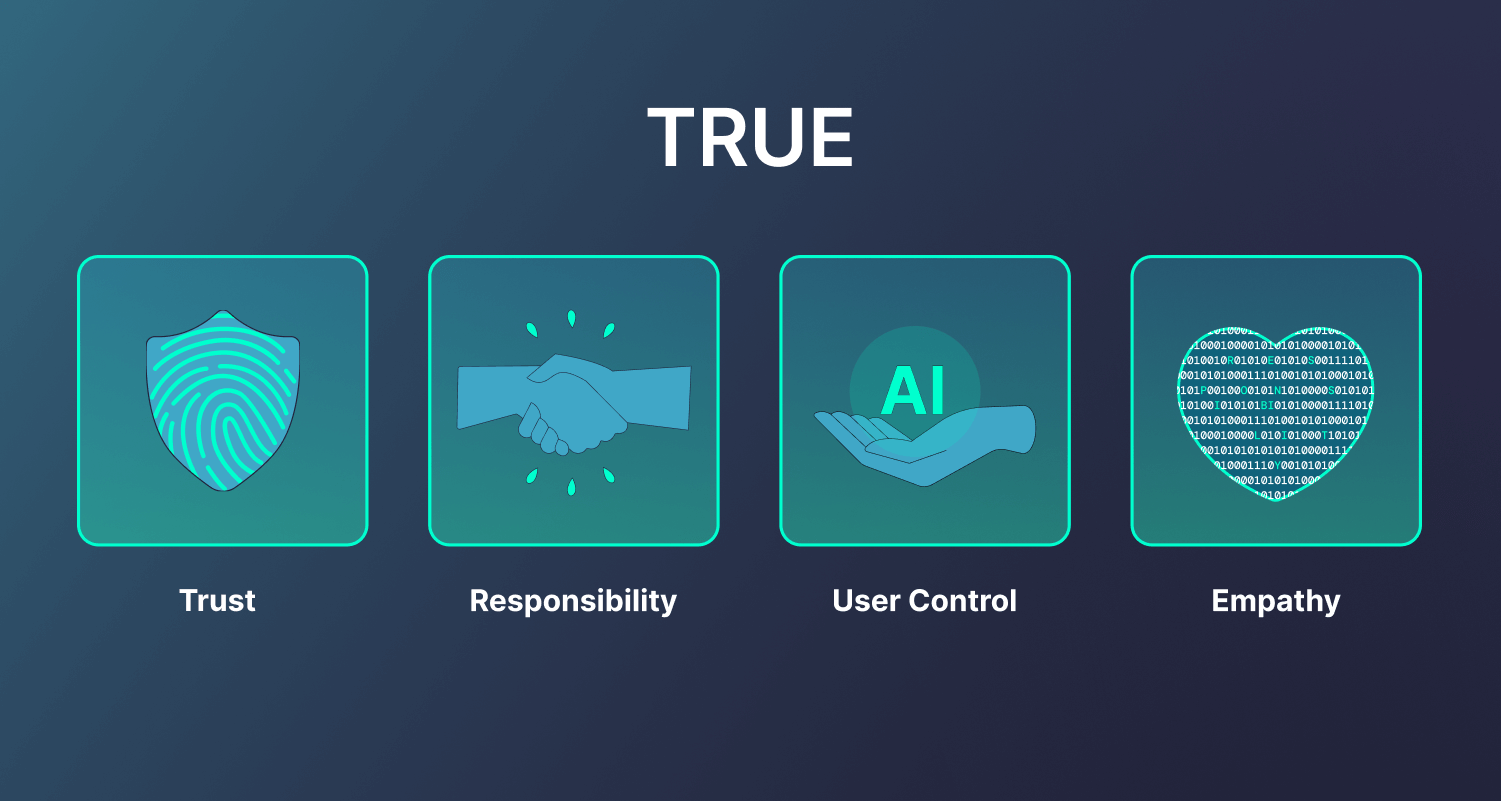

À medida que implementamos a assistência generativa de IA do Grammarly para nossos usuários e clientes, a implantação responsável da IA continua sendo uma prioridade. Já escrevi sobre a abordagem da Grammarly para inteligência aumentada – a ideia de que a IA só tem sucesso quando aplicada de uma forma que aumenta e capacita as pessoas a atingirem seu potencial. A inteligência aumentada sustenta nossa filosofia de desenvolvimento de produtos e informa a estrutura TRUE, que compartilhei no SXSW para demonstrar como a equipe de produtos da Grammarly aborda todas as tecnologias que utilizamos, incluindo IA generativa.

Estruturas de IA responsáveis como TRUE podem orientar o desenvolvimento de produtos que melhoram as pessoas em todos os setores, tecnologias e casos de uso. Quando estas estruturas são implementadas em grande escala, podemos criar um futuro onde indivíduos e empresas realizem todo o seu potencial, construam conexões mais profundas e gerem resultados. Acredito que a estrutura TRUE, que se baseia em quatro princípios fundamentais – Confiança, Responsabilidade, Controle do Usuário e Empatia – pode nos mover na direção deste futuro.

Veja aqui como estamos aplicando a estrutura TRUE para garantir que nossa implantação de IA generativa cumpra nossa promessa de aumentar nossos clientes, ao mesmo tempo em que priorizamos sua autonomia, privacidade e segurança.

Confiança: Colocandoos padrões e práticas de segurança e privacidade em primeiro lugar

O compromisso permanente da Grammarly com a privacidade e a segurança lidera nossa estrutura VERDADEIRA e é a base do nosso modelo de negócios. Alinhar nossos incentivos com os de nossos clientes é fundamental para construir confiança. Ganhamos dinheiro vendendo assinaturas – não vendemos dados de clientes a terceiros para publicidade ou treinamento. Além disso, desidentificamos e anonimizamos os dados dos utilizadores, mantendo-os apenas durante o tempo necessário para fornecer e melhorar o nosso serviço.

Se a privacidade tem a ver com a forma como protegemos os direitos dos utilizadores para controlar e aceder aos seus dados, a segurança tem tudo a ver com a forma como protegemos esses dados. Estamos profundamente comprometidos com a segurança – e com quatorze anos de investimento em nosso currículo, pensamos na segurança como o recurso de produto mais importante no coração do nosso ecossistema de produtos.

Operamos com uma cultura obcecada pela segurança, mantendo as melhores políticas e práticas, como logon único para todas as contas Grammarly Business, testes de penetração de terceiros e incorporando nossos especialistas internos em segurança às nossas equipes de produto e engenharia. . Essas salvaguardas nos permitem obter atestados e certificações de terceiros. Mantemos esses padrões elevados à medida que implantamos novos recursos generativos de IA em nossos produtos.

Responsabilidade: Construir e melhorar sistemas de IA que reduzam preconceitos e promovam justiça

Os resultados de um concurso de previsões liderado por Jacob Steinhardt, professor da Universidade da Califórnia, Berkeley, sugerem que as capacidades de aprendizagem automática estão a progredir mais rapidamente do que a sua capacidade de desempenho fiável com conjuntos de dados novos e inesperados. Isso significa que os tecnólogos têm a responsabilidade de implementar proteções que tornem a IA mais segura.

Nossa equipe de IA responsável faz isso diariamente, construindo conjuntos de dados de qualidade e empregando táticas para garantir que os algoritmos em nossos produtos não perpetuem preconceitos ou estereótipos. Usamos tecnologias internas para evitar que a IA generativa do Grammarly interaja com tópicos delicados, mitigando o risco de questões de segurança.

Parte do desenvolvimento responsável da IA é reconhecer que nenhum sistema é perfeito. É por isso que fornecemos vários mecanismos para que os usuários relatem problemas em nossos produtos e tenhamos um processo operacional rigoroso implementado para resolver problemas de forma rápida e consistente e melhorar nossos modelos.

Controle de usuários: Ajudar pessoas e empresas a atingirem todo o seu potencial, respeitando sua autonomia

À medida que a assistência à comunicação baseada em IA se torna mais avançada, não há como substituir a voz humana. A comunicação é extremamente pessoal e é vital para nós que os nossos clientes permaneçam sempre no controlo e que a tecnologia que fornecemos ajude as pessoas e as empresas a atingirem o seu potencial máximo.

Projetamos cuidadosamente a assistência generativa de IA do Grammarly para fornecer opções e sugestões a serem consideradas - sempre deixando para o cliente decidir o que é melhor para ele. Isto não foi acidental – respeitar a autonomia dos nossos utilizadores ajuda a garantir que a nossa tecnologia cumpre o seu propósito de aumentá-los. Com a IA generativa da Grammarly, estamos ajudando as pessoas a economizar tempo na escrita diária, capacitando-as a gastar mais de sua valiosa energia elaborando grandes ideias, desenvolvendo estratégias criativas e colaborando no trabalho mais impactante em suas organizações.

Empatia: Colocar-se no lugar dos nossos clientes para compreender e responder às suas reais necessidades

Acreditamos que uma forma crucial de minimizar os resultados não intencionais das novas tecnologias é concentrar-nos na abordagem dos desafios específicos que as pessoas enfrentam. Procuramos constantemente novas tecnologias para aprofundar o valor que entregamos aos nossos clientes, e esta foi uma motivação para integrar IA generativa nos nossos produtos.

Por exemplo, a assistência generativa de IA do Grammarly pode ajudar as pessoas a superar o problema da “página em branco” – algo com o qual 84% dos usuários do Grammarly nos disseram que queriam suporte. Além disso, ouvimos de nossos usuários que eles estavam enfrentando dificuldades com o volume de e-mails que recebiam e que estavam sobrecarregados com a tarefa de responder de forma rápida e eficiente. Em resposta a esse problema, criamos recursos generativos de IA que permitem que as pessoas respondam rapidamente a e-mails de maneira contextualmente relevante e personalizada.

À medida que introduzimos novos casos de uso nas ofertas de produtos da Grammarly, essa intenção permanecerá em primeiro plano.

O futuro da IA é aumentado

Embora eu tenha compartilhado apenas um exemplo de como a Grammarly usou recentemente a estrutura TRUE, espero que qualquer pessoa que desenvolva produtos com novas tecnologias replique ou encontre inspiração nesta abordagem. Estou confiante de que o futuro da IA está na inteligência aumentada – e estou encorajado pelas conversas no SXSW e em todo o setor sobre como manter as pessoas no centro das decisões de produtos.

Quero viver num mundo onde utilizemos a IA para nos tornarmos melhores, capacitando indivíduos e equipas para atingirem o seu potencial e gerarem grandes impactos nas empresas, organizações e indústrias. À medida que nos adaptamos e aprendemos como sociedade, estruturas como a TRUE podem ajudar-nos a tornar esse futuro uma realidade.

Em minha nova função como novo CEO da Grammarly, nossa promessa de aumentar nossos clientes é tão importante para mim como sempre – e mal posso esperar para continuar construindo esse legado enquanto a Grammarly entra em uma nova era com IA generativa.